Introducción al modelo o3-Mini de OpenAI

OpenAI ha lanzado su modelo más reciente en la serie de razonamiento, o3-Mini. En este artículo, exploraremos qué es o3-Mini, sus capacidades y cómo se desempeña en comparación con el modelo de la serie o1. También discutiremos cómo acceder a este modelo con una demostración.

¿Qué es o3-Mini?

Introduction to o3-Mini

o3-Mini es el modelo más rentable en la serie de razonamiento de OpenAI. Es un modelo pequeño que está diseñado para ser rápido y potente, superando los límites de lo que pueden lograr los modelos pequeños. El modelo está disponible para su uso en chatbots y se puede integrar en aplicaciones utilizando la OpenAI API.

Introduction to o3-Mini

o3-Mini es el modelo más rentable en la serie de razonamiento de OpenAI. Es un modelo pequeño que está diseñado para ser rápido y potente, superando los límites de lo que pueden lograr los modelos pequeños. El modelo está disponible para su uso en chatbots y se puede integrar en aplicaciones utilizando la OpenAI API.

Características de o3-Mini

Features of o3-Mini

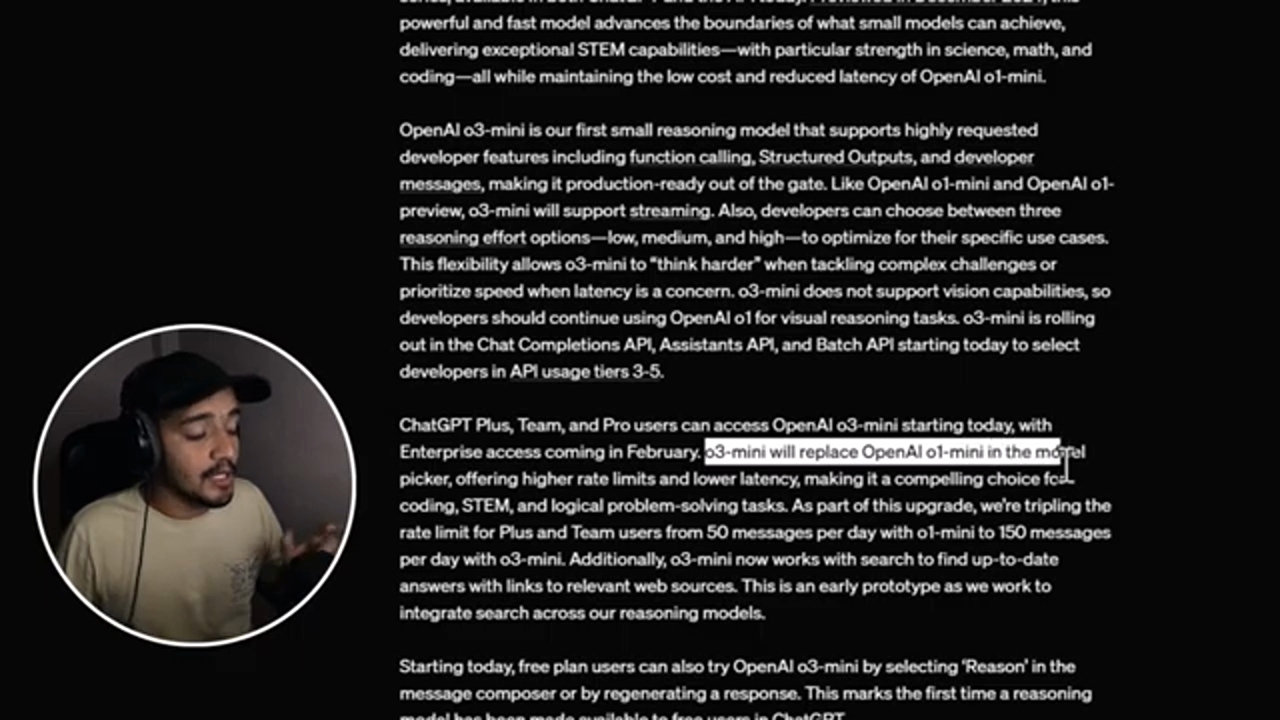

Algunas de las características clave de o3-Mini incluyen la llamada a funciones, la salida de estructura y la mensajería para desarrolladores, lo que lo hace listo para producción. El modelo también admite streaming, lo que permite respuestas en tiempo real. Además, o3-Mini tiene la opción de elegir entre un esfuerzo de razonamiento bajo, medio y alto, lo que permite a los desarrolladores ajustar el modelo a sus necesidades específicas.

Features of o3-Mini

Algunas de las características clave de o3-Mini incluyen la llamada a funciones, la salida de estructura y la mensajería para desarrolladores, lo que lo hace listo para producción. El modelo también admite streaming, lo que permite respuestas en tiempo real. Además, o3-Mini tiene la opción de elegir entre un esfuerzo de razonamiento bajo, medio y alto, lo que permite a los desarrolladores ajustar el modelo a sus necesidades específicas.

Comparación con o1 Mini

Comparison to o1 Mini

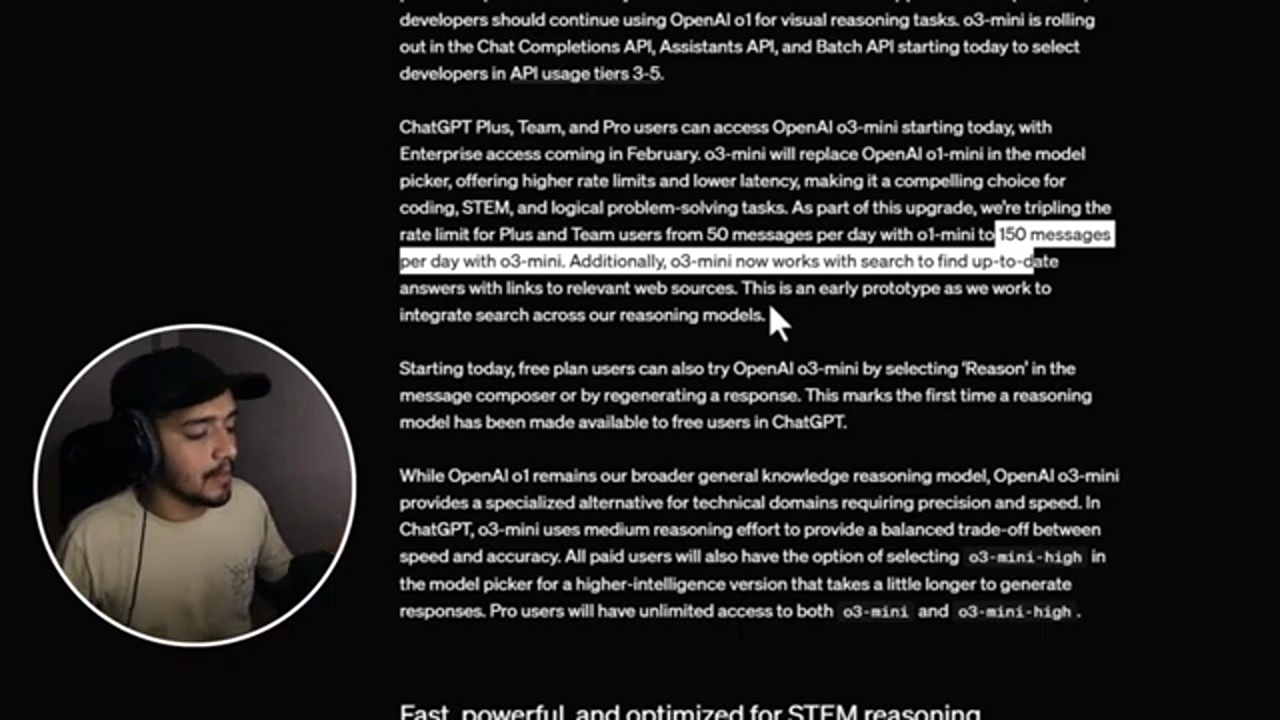

En comparación con o1 Mini, o3-Mini tiene un costo más bajo y una velocidad más rápida. El modelo también es más potente y puede manejar tareas más complejas. o3-Mini reemplazará a o1 Mini en el selector de modelos, ofreciendo límites de velocidad más altos y menor latencia.

Comparison to o1 Mini

En comparación con o1 Mini, o3-Mini tiene un costo más bajo y una velocidad más rápida. El modelo también es más potente y puede manejar tareas más complejas. o3-Mini reemplazará a o1 Mini en el selector de modelos, ofreciendo límites de velocidad más altos y menor latencia.

Acceso a o3-Mini

Access to o3-Mini

o3-Mini está disponible para los usuarios de GPT-4 Plus team y pro, con acceso empresarial a partir de febrero. Los usuarios gratuitos también pueden probar o3-Mini seleccionando "razonamiento" en el compositor de mensajes y regenerando una respuesta. Sin embargo, no se menciona ningún límite o límite diario para los usuarios gratuitos, que puede ajustarse a medida que se utiliza el modelo.

Access to o3-Mini

o3-Mini está disponible para los usuarios de GPT-4 Plus team y pro, con acceso empresarial a partir de febrero. Los usuarios gratuitos también pueden probar o3-Mini seleccionando "razonamiento" en el compositor de mensajes y regenerando una respuesta. Sin embargo, no se menciona ningún límite o límite diario para los usuarios gratuitos, que puede ajustarse a medida que se utiliza el modelo.

Rendimiento de o3-Mini

Performance of o3-Mini

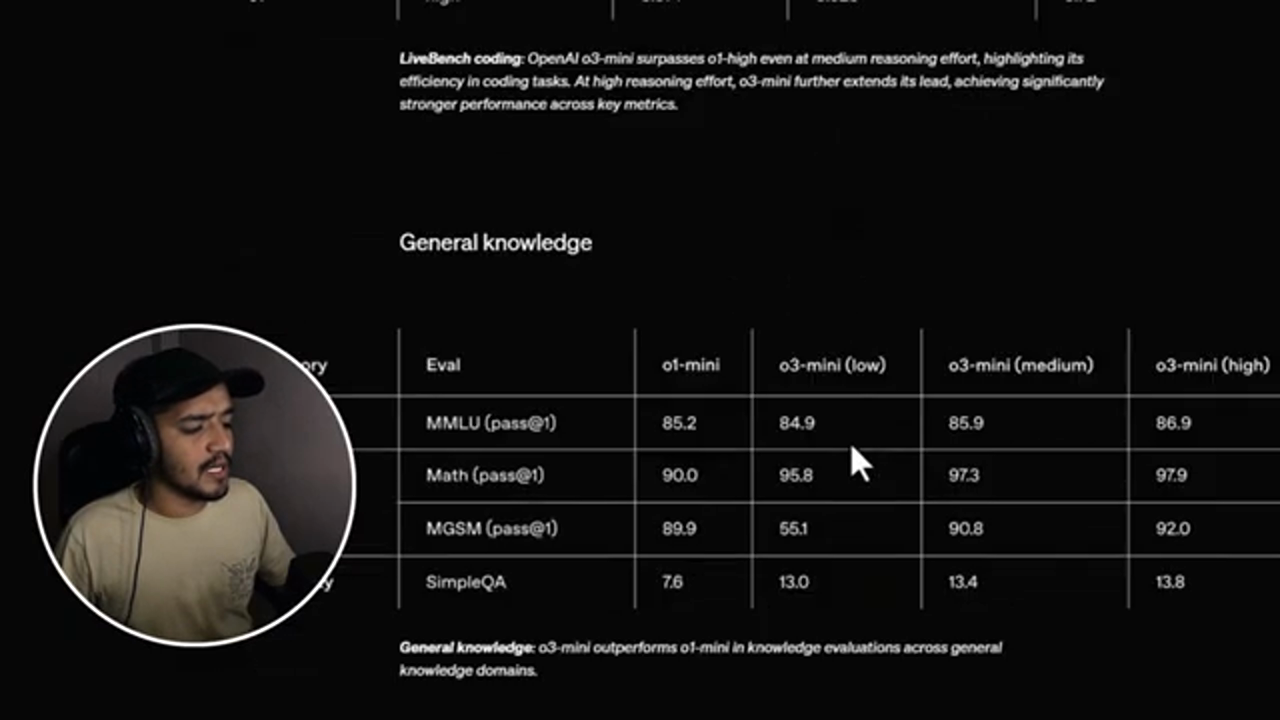

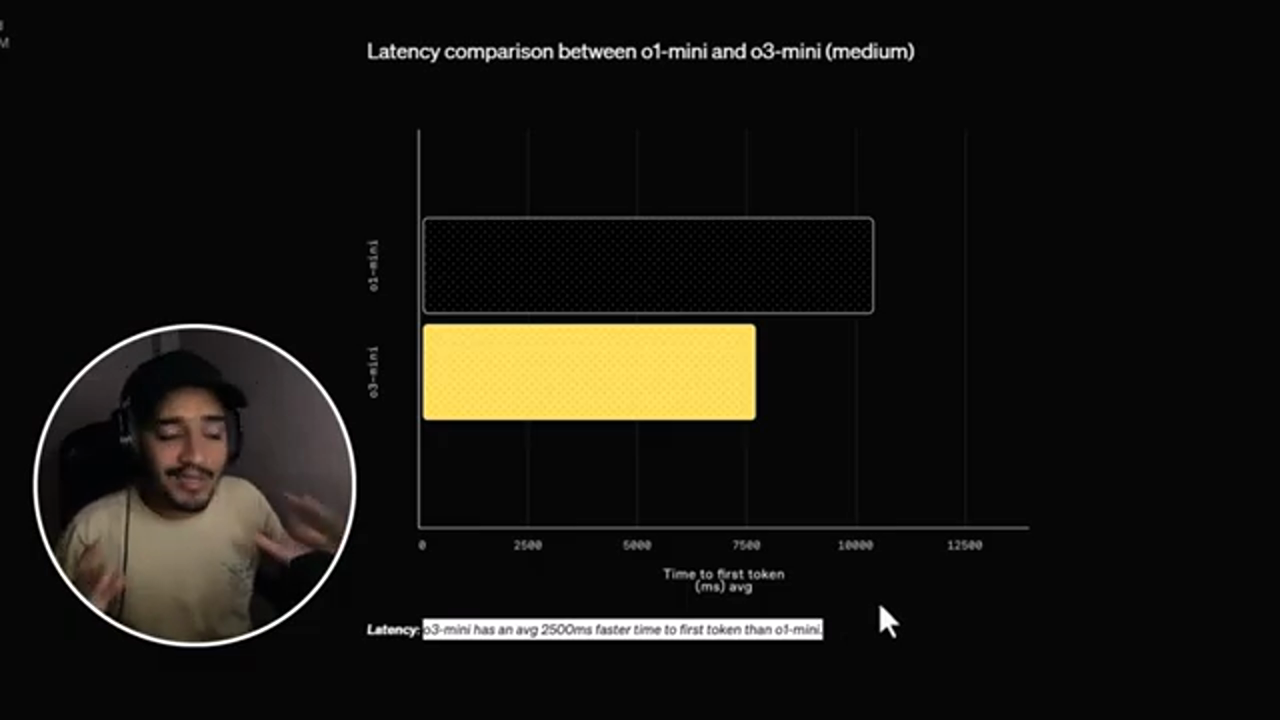

En términos de rendimiento, o3-Mini se ha comparado con los modelos o1 en matemáticas de competencia, preguntas de ciencia a nivel de doctorado y codificación. Los resultados muestran que o3-Mini tiene un mejor rendimiento que los modelos o1 en estas áreas. Además, o3-Mini tiene una velocidad más rápida, con un promedio de 2500 milisegundos más rápido en el tiempo hasta el primer token que o1 Mini.

Performance of o3-Mini

En términos de rendimiento, o3-Mini se ha comparado con los modelos o1 en matemáticas de competencia, preguntas de ciencia a nivel de doctorado y codificación. Los resultados muestran que o3-Mini tiene un mejor rendimiento que los modelos o1 en estas áreas. Además, o3-Mini tiene una velocidad más rápida, con un promedio de 2500 milisegundos más rápido en el tiempo hasta el primer token que o1 Mini.

Demostración de o3-Mini

Demo of o3-Mini

En la demostración, o3-Mini se utiliza para crear una animación de una pelota que rebota usando Python. El modelo puede generar un código completo que simula el escenario, teniendo en cuenta la gravedad y la fricción. La animación resultante es realista e impresionante.

Demo of o3-Mini

En la demostración, o3-Mini se utiliza para crear una animación de una pelota que rebota usando Python. El modelo puede generar un código completo que simula el escenario, teniendo en cuenta la gravedad y la fricción. La animación resultante es realista e impresionante.

Conclusión

Conclusion

En conclusión, o3-Mini es un modelo potente y rentable que está diseñado para fines STEM, incluyendo ciencia, matemáticas y codificación. El modelo tiene una velocidad más rápida y un costo más bajo en comparación con o1 Mini y está disponible para los usuarios de GPT-4 Plus team y pro. Los usuarios gratuitos también pueden probar o3-Mini seleccionando "razonamiento" en el compositor de mensajes y regenerando una respuesta.

Conclusion

En conclusión, o3-Mini es un modelo potente y rentable que está diseñado para fines STEM, incluyendo ciencia, matemáticas y codificación. El modelo tiene una velocidad más rápida y un costo más bajo en comparación con o1 Mini y está disponible para los usuarios de GPT-4 Plus team y pro. Los usuarios gratuitos también pueden probar o3-Mini seleccionando "razonamiento" en el compositor de mensajes y regenerando una respuesta.

Planes futuros

Future Plans

En el futuro, planeamos probar o3-Mini más a fondo y compararlo con otros modelos, incluyendo deep r1. También exploraremos las posibilidades de usar o3-Mini en varias aplicaciones y proporcionaremos más información sobre sus capacidades y limitaciones.

Future Plans

En el futuro, planeamos probar o3-Mini más a fondo y compararlo con otros modelos, incluyendo deep r1. También exploraremos las posibilidades de usar o3-Mini en varias aplicaciones y proporcionaremos más información sobre sus capacidades y limitaciones.