Giới thiệu về Tự lưu trữ n8n miễn phí

Tự lưu trữ n8n có thể là một cách tiết kiệm chi phí để tự động hóa quy trình làm việc mà không phải trả tiền cho phiên bản đám mây. Trong bài viết này, chúng ta sẽ khám phá cách tự lưu trữ n8n hoàn toàn miễn phí bằng cách sử dụng npm.

Vì sao n8n lại trở nên phổ biến

Như đã thấy trên Google Trends và YouTube, n8n ngày càng trở nên phổ biến. Người tạo video đã thực hiện một vài video về n8n bằng phiên bản dùng thử miễn phí, có giá khởi điểm là 20 đô la một tháng và giá chuyên nghiệp là 50 đô la một tháng. Tuy nhiên, một người bình luận đã chỉ ra rằng n8n không miễn phí, mà là một giải pháp mã nguồn mở miễn phí khi tự lưu trữ.

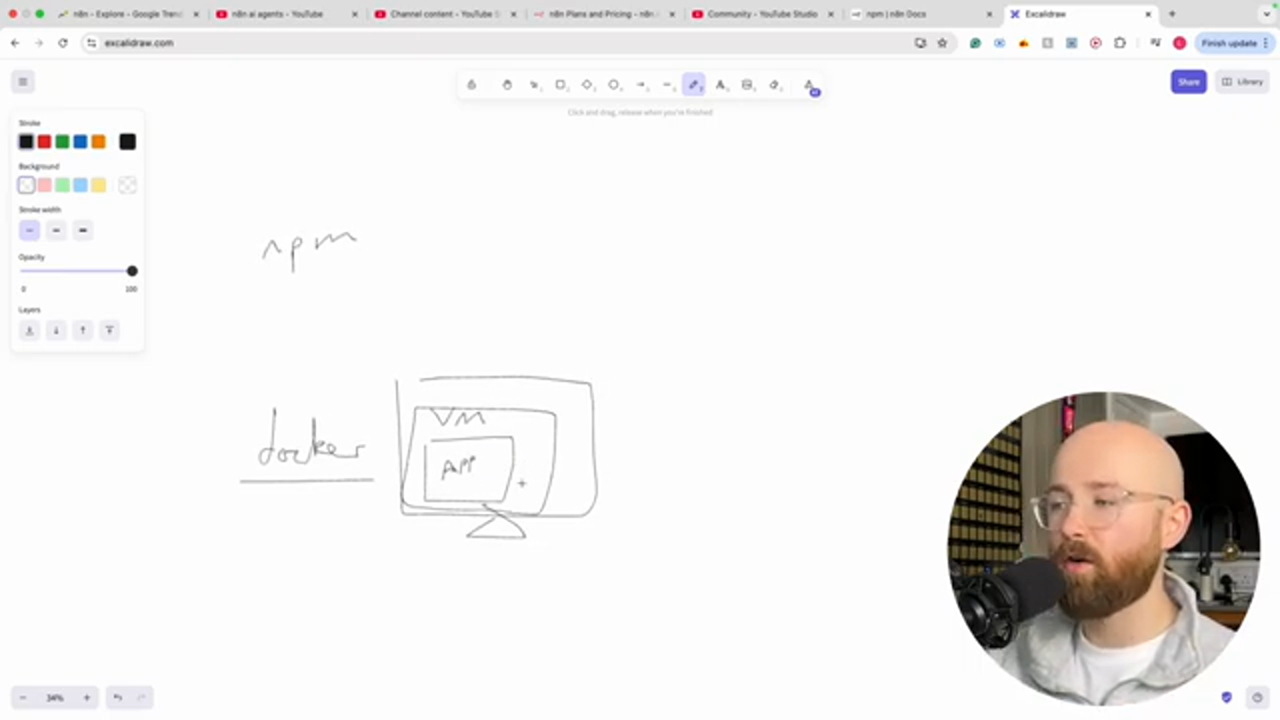

Làm thế nào để tự lưu trữ n8n

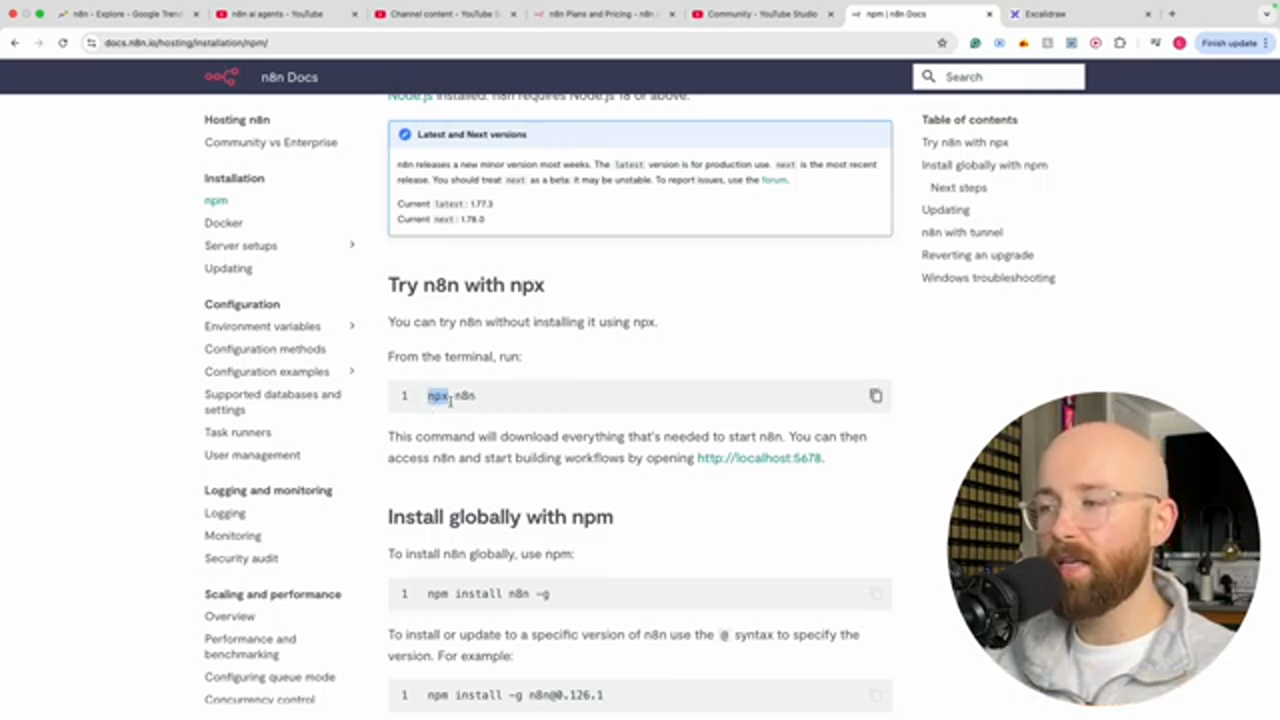

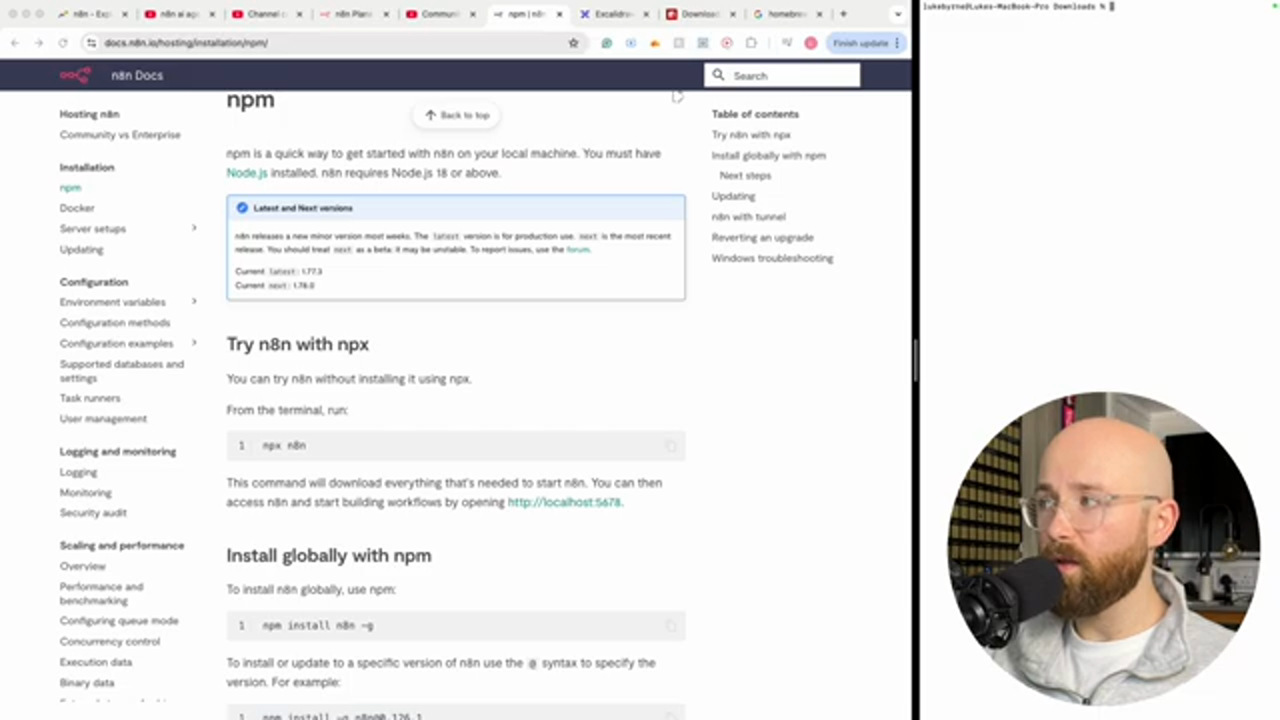

Để tự lưu trữ n8n, chúng ta cần cài đặt Node.js và npm. Có hai cách để cài đặt n8n: sử dụng npm hoặc Docker. Docker được sử dụng để biến các ứng dụng thành vùng chứa, giúp quản lý và triển khai ứng dụng dễ dàng hơn. Tuy nhiên, đối với hướng dẫn này, chúng ta sẽ sử dụng npm, là một trình quản lý gói cho Node.js.

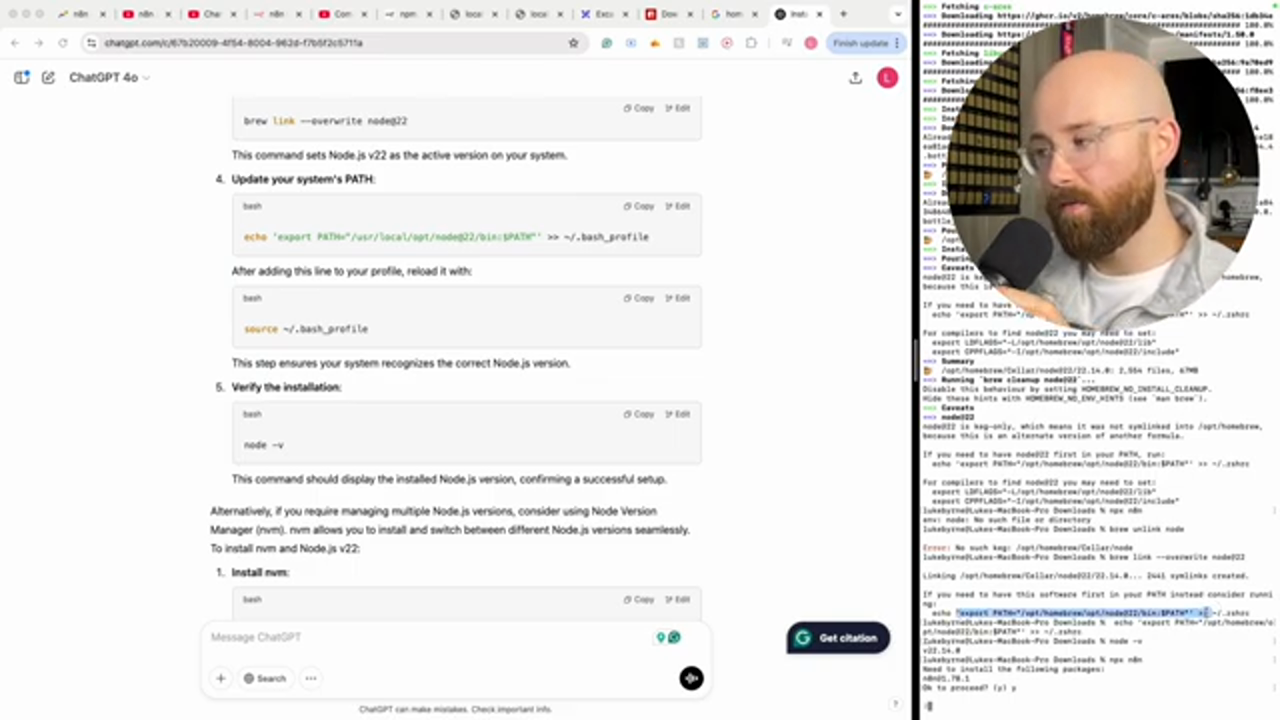

Cài đặt Node.js và npm

Để cài đặt Node.js và npm, chúng ta có thể sử dụng một trình quản lý gói như Homebrew. Sau khi cài đặt, chúng ta có thể sử dụng npm để cài đặt n8n. Chúng ta có thể sử dụng lệnh npx n8n để chạy n8n cục bộ.

Chạy n8n cục bộ

Sau khi cài đặt, chúng ta có thể chạy n8n cục bộ bằng lệnh npx n8n. Thao tác này sẽ khởi động máy chủ n8n và chúng ta có thể truy cập nó bằng cách truy cập http://localhost:5678.

Thiết lập n8n

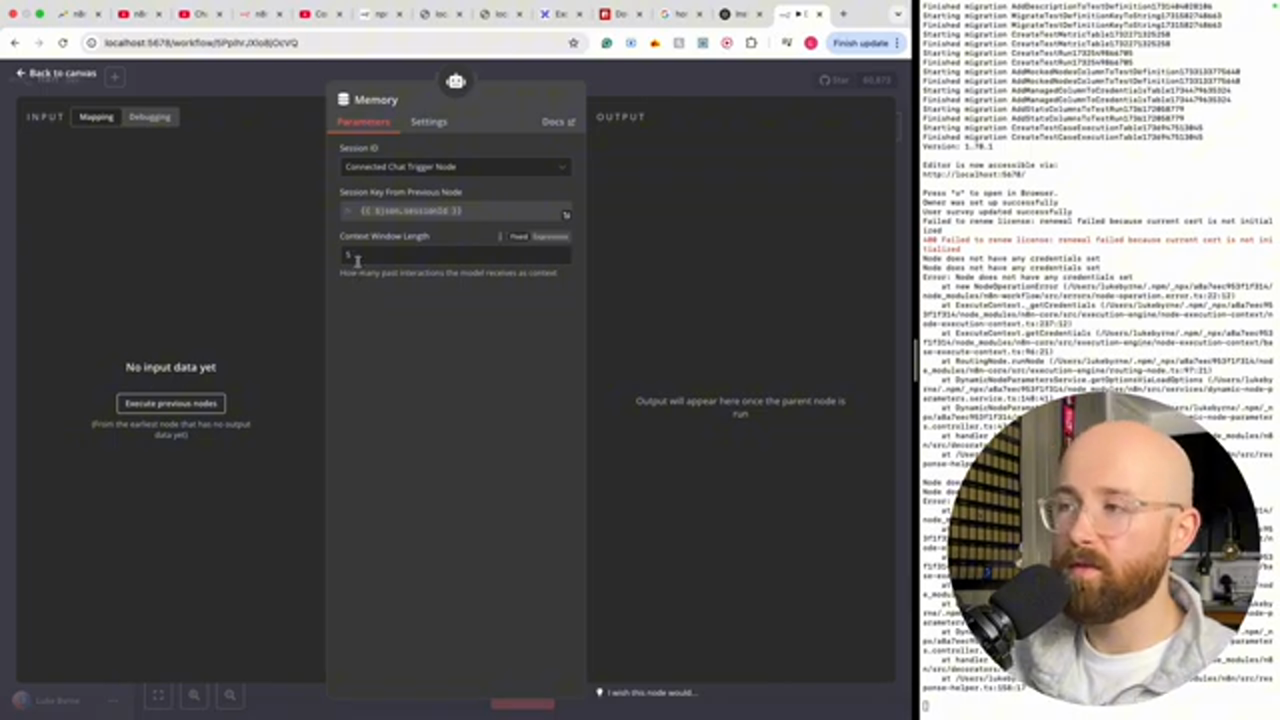

Để thiết lập n8n, chúng ta cần tạo một tài khoản chủ sở hữu và thiết lập một quy trình làm việc. Chúng ta có thể sử dụng trình chỉnh sửa quy trình làm việc tích hợp để tạo một quy trình làm việc mới.

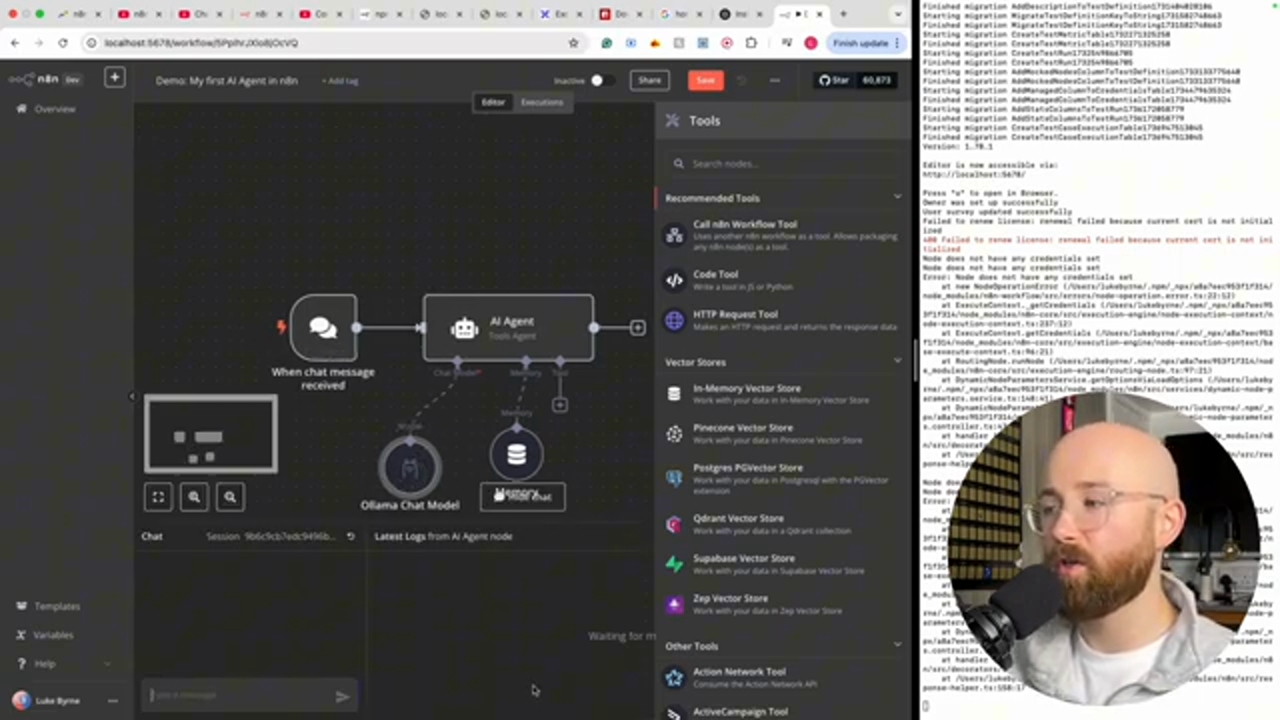

Tích hợp AI Agent với n8n

Chúng ta có thể tích hợp AI Agent với n8n bằng trình chỉnh sửa quy trình làm việc tích hợp. Chúng ta có thể tạo một quy trình làm việc mới và thêm một AI Agent vào đó.

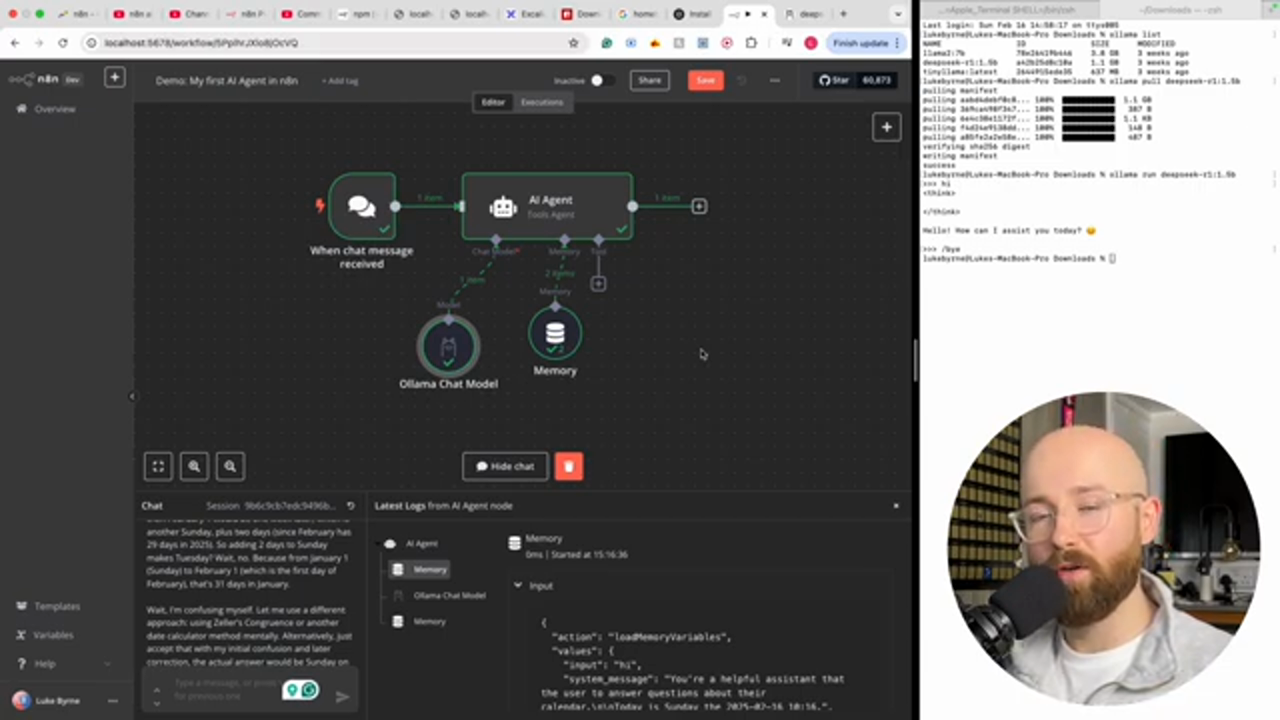

Chạy LLM cục bộ với Ollama

Chúng ta có thể chạy các mô hình ngôn ngữ lớn (LLM) cục bộ bằng Ollama. Ollama là một cách để chạy các mô hình ngôn ngữ hoàn toàn miễn phí và dễ dàng.

Kết luận

Tóm lại, tự lưu trữ n8n có thể là một cách tiết kiệm chi phí để tự động hóa quy trình làm việc mà không phải trả tiền cho phiên bản đám mây. Chúng ta có thể sử dụng npm để cài đặt n8n và chạy nó cục bộ. Chúng ta cũng có thể tích hợp AI Agent với n8n và chạy LLM cục bộ bằng Ollama.

Những suy nghĩ cuối cùng

Cuối cùng, chúng ta có thể sử dụng n8n để tự động hóa quy trình làm việc và tích hợp AI Agent với nó. Chúng ta cũng có thể chạy LLM cục bộ bằng Ollama.

Các bước tiếp theo

Tiếp theo, chúng ta có thể tạo một cộng đồng để học hỏi và chia sẻ kiến thức về n8n và AI.

Tham gia cộng đồng Applied AI

Chúng ta có thể tham gia cộng đồng Applied AI để học hỏi và chia sẻ kiến thức về n8n và AI.