免费自托管 n8n 介绍

自托管 n8n 是一种成本效益较高的自动化工作流方式,无需支付云版本的费用。在本文中,我们将探讨如何使用 npm 完全免费地自托管 n8n。

为什么 n8n 如此火爆

从 Google Trends 和 YouTube 可以看出,n8n 的受欢迎程度一直在上升。视频创作者之前用免费试用版制作了几个关于 n8n 的视频,该版本的起价为每月 20 美元,专业版为每月 50 美元。然而,一位评论者指出,n8n 并非免费的,但当自托管时,它是一个免费的开源解决方案。

如何自托管 n8n

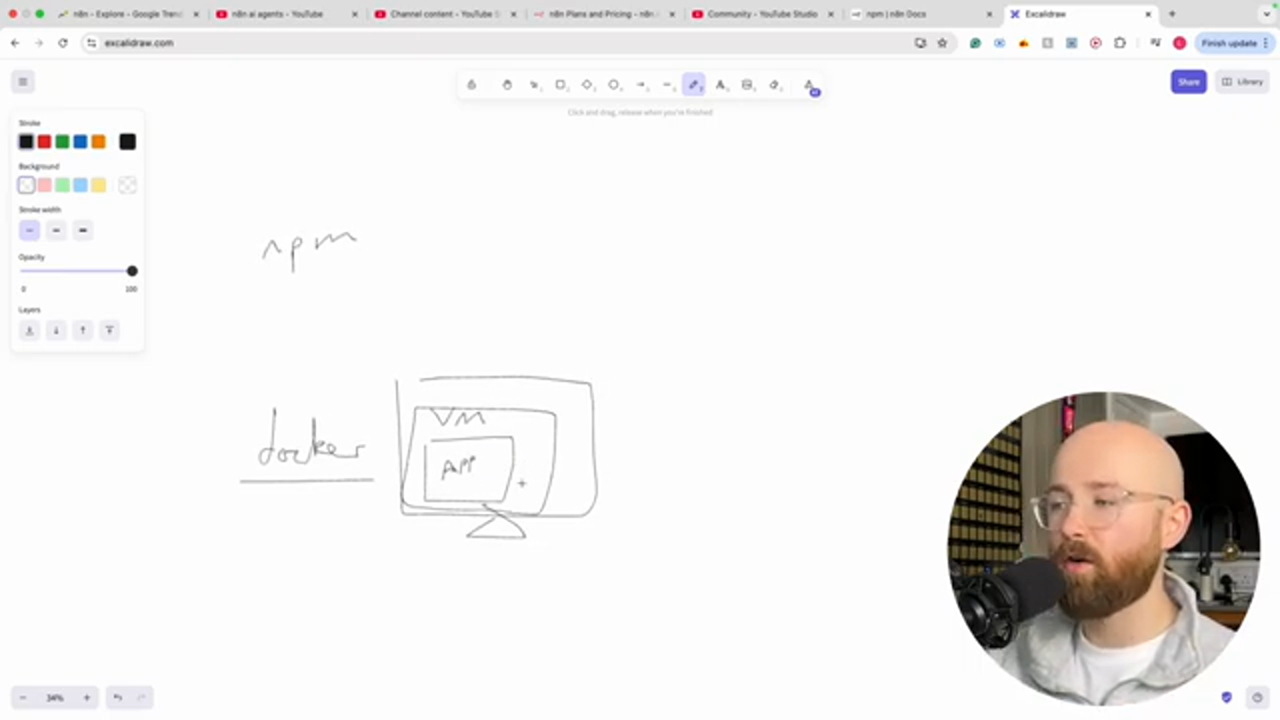

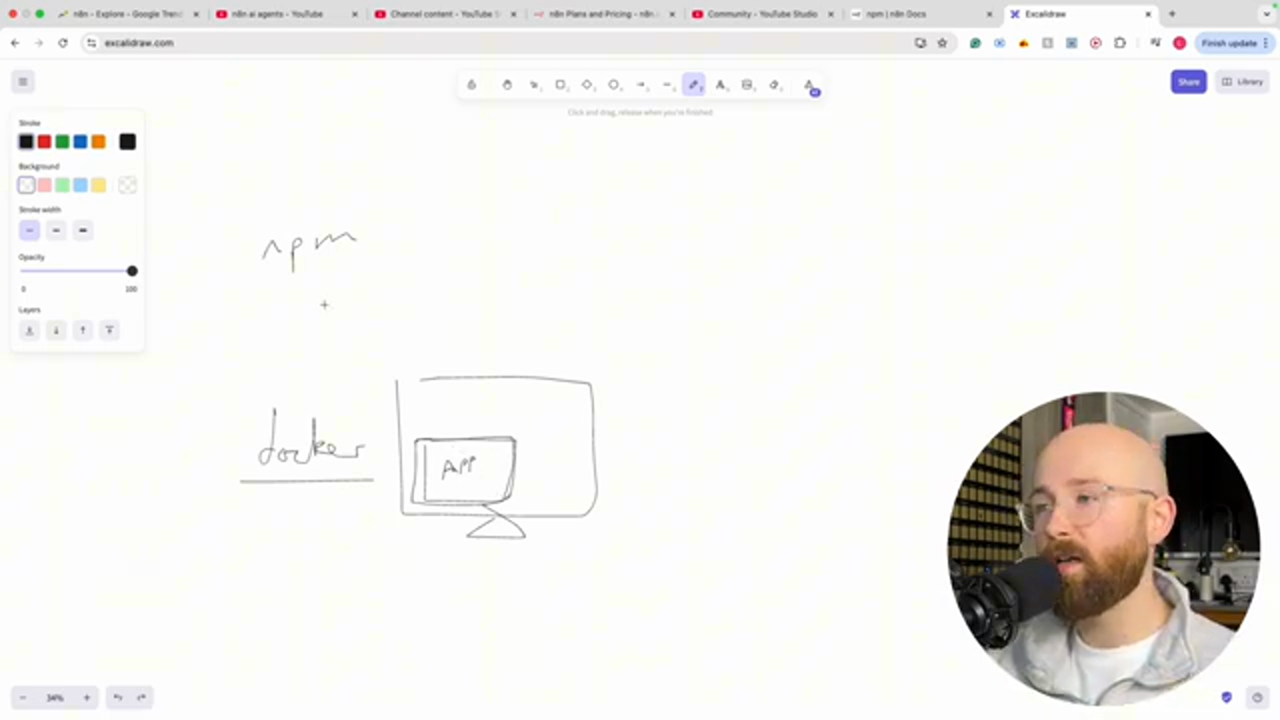

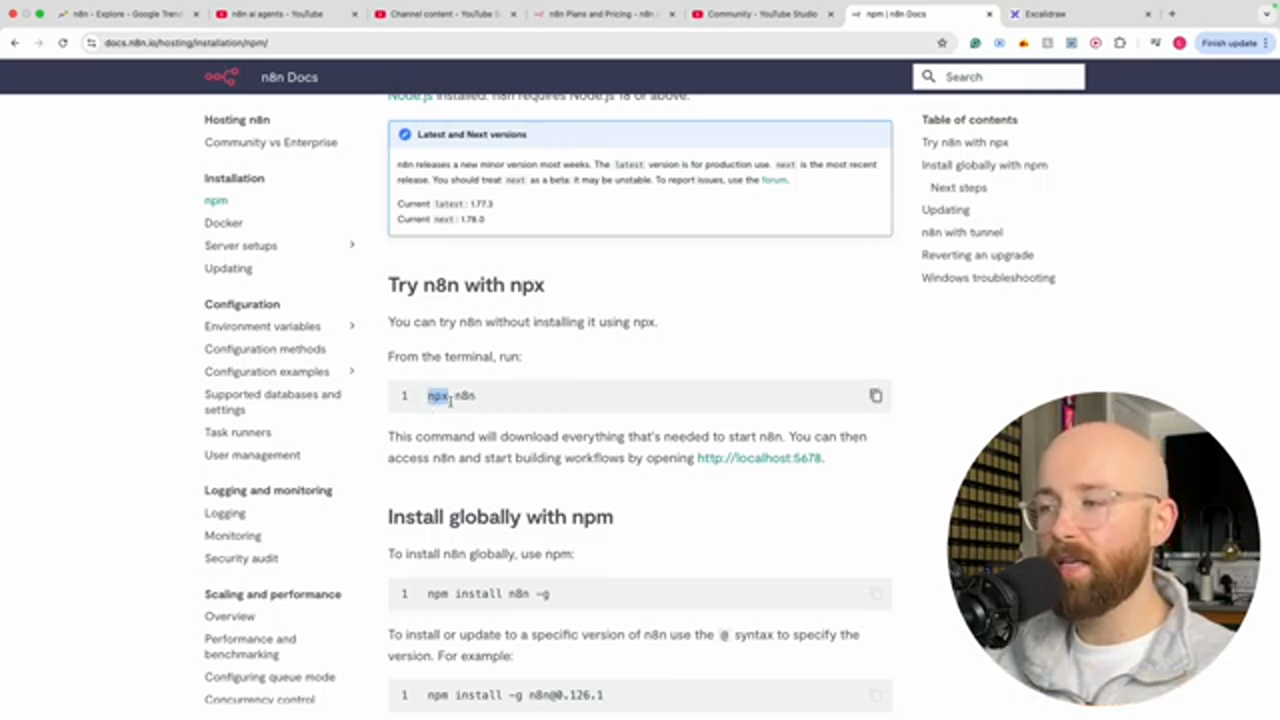

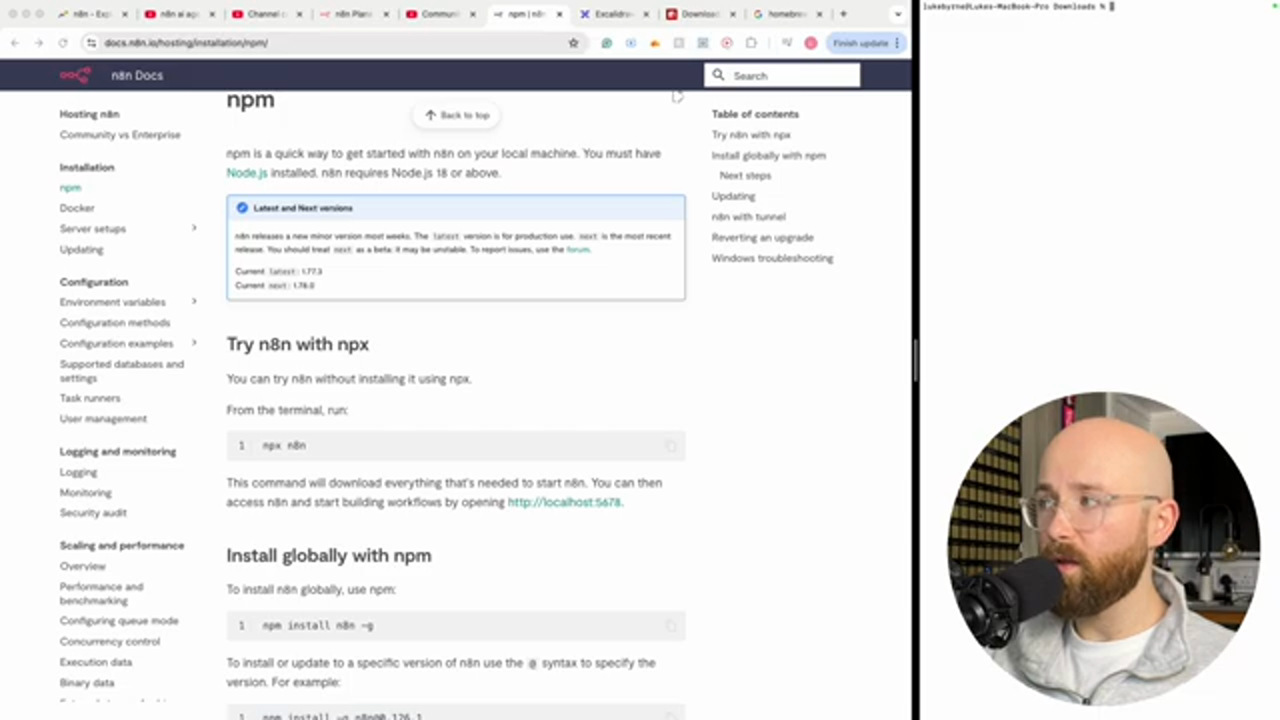

要自托管 n8n,我们需要安装 Node.js 和 npm。安装 n8n 有两种方式:使用 npm 或 Docker。Docker 用于将应用程序转换为容器,使其更易于管理和部署应用程序。但在本教程中,我们将使用 npm,它是 Node.js 的包管理器。

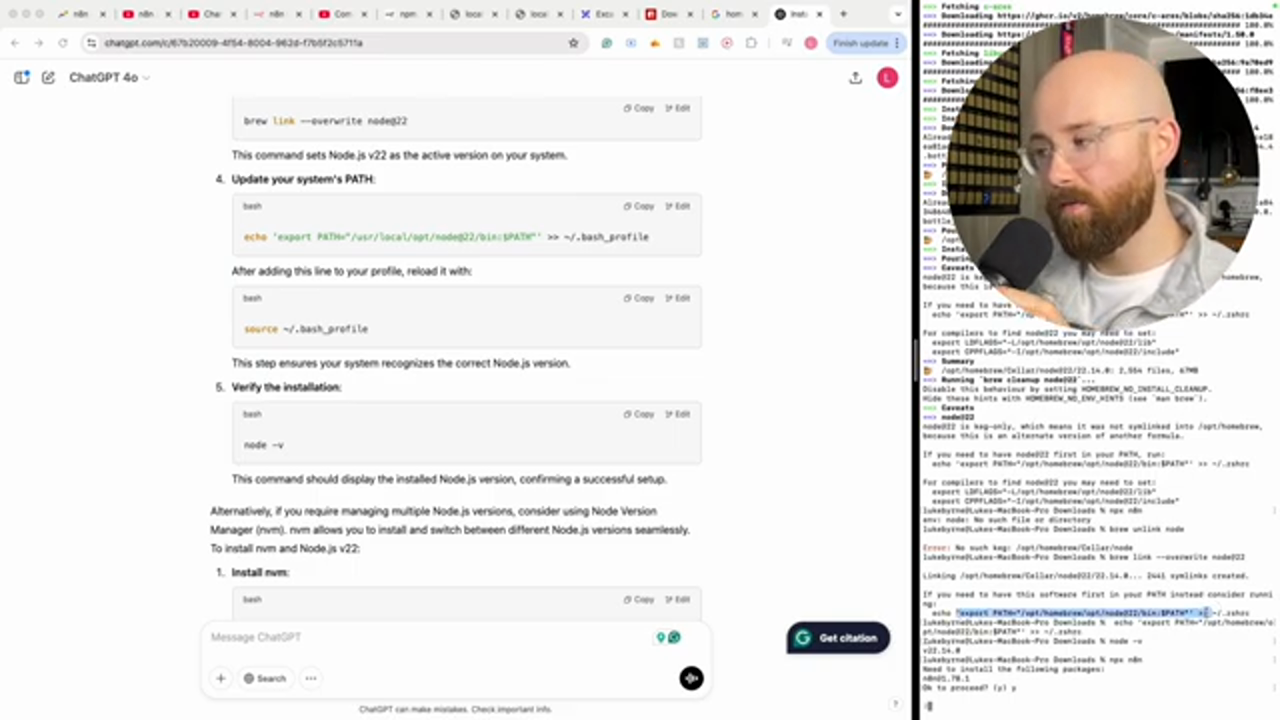

安装 Node.js 和 npm

要安装 Node.js 和 npm,我们可以使用 Homebrew 等包管理器。安装完成后,我们可以使用 npm 安装 n8n。我们可以使用命令 npx n8n 来本地运行 n8n。

本地运行 n8n

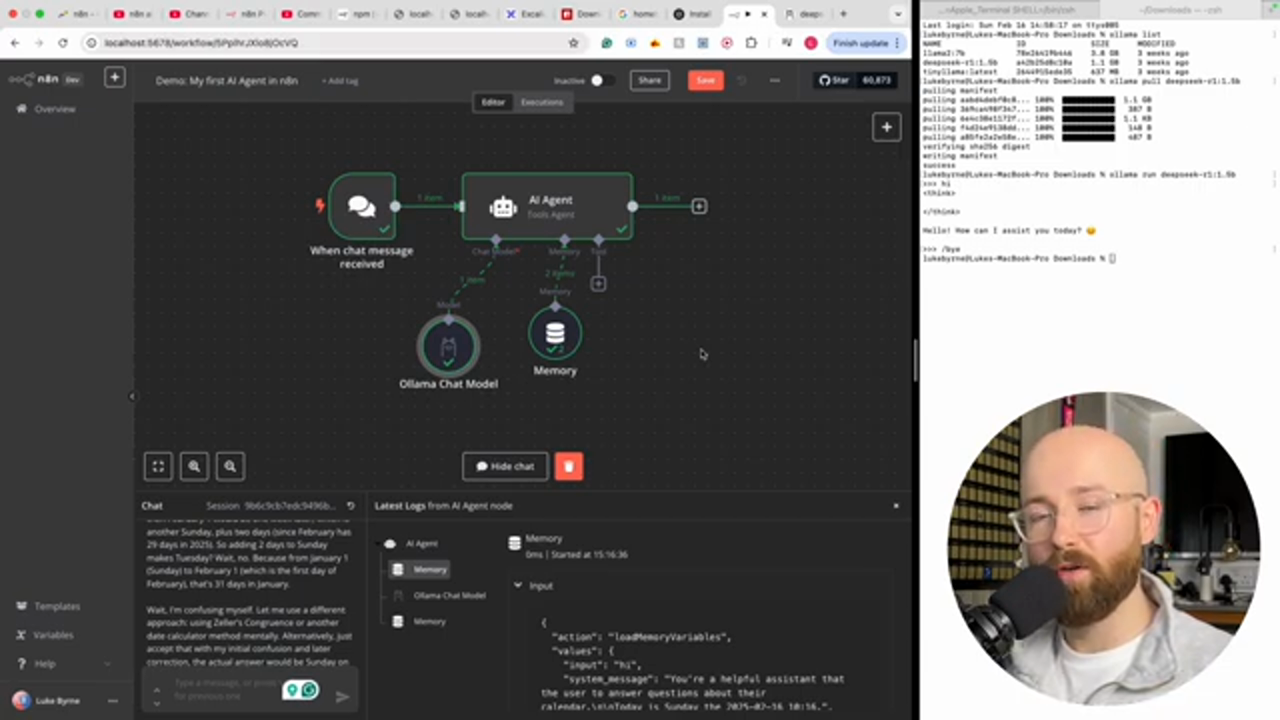

安装完成后,我们可以使用命令 npx n8n 在本地运行 n8n。这将启动 n8n 服务器,我们可以通过访问 http://localhost:5678 来使用它。

设置 n8n

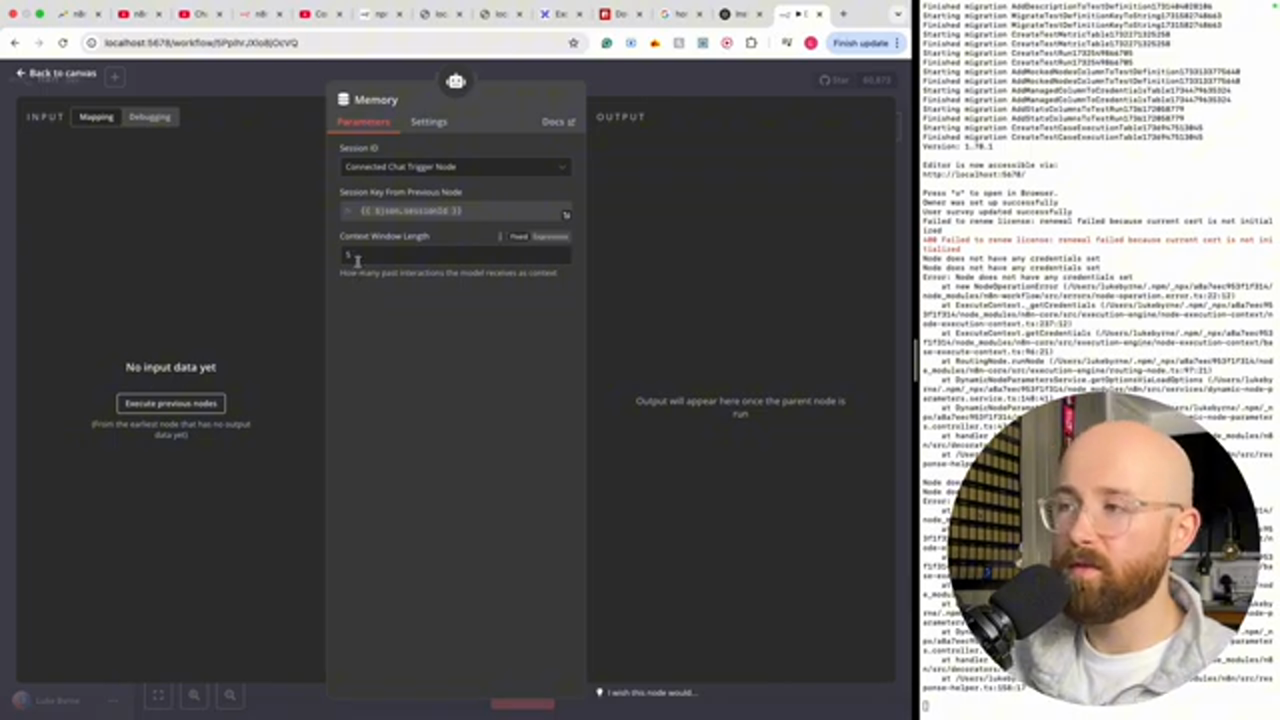

要设置 n8n,我们需要创建一个所有者账户并设置一个工作流。我们可以使用内置的工作流编辑器来创建一个新的工作流。

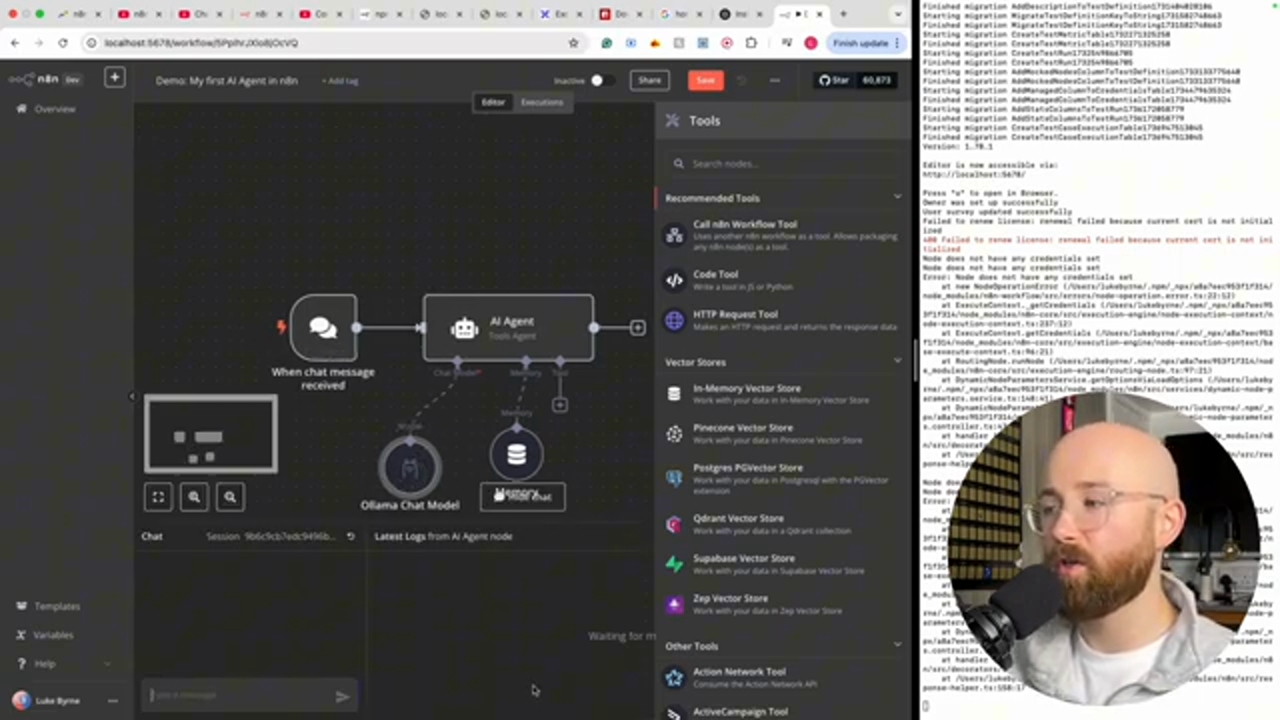

将 AI 代理与 n8n 集成

我们可以使用内置的工作流编辑器将 AI 代理与 n8n 集成。我们可以创建一个新的工作流并添加一个 AI 代理。

使用 Ollama 本地运行 LLM

我们可以使用 Ollama 本地运行大型语言模型(LLM)。Ollama 是一种完全免费且易于运行语言模型的方式。

结论

总之,自托管 n8n 是一种成本效益较高的自动化工作流方式,无需支付云版本的费用。我们可以使用 npm 安装 n8n 并在本地运行它。我们还可以将 AI 代理与 n8n 集成,并使用 Ollama 本地运行 LLM。

最后的话

最后,我们可以使用 n8n 自动化工作流并将其与 AI 代理集成。我们还可以使用 Ollama 本地运行 LLM。

下一步

接下来,我们可以创建一个社区,学习和分享关于 n8n 和 AI 的知识。

加入 Applied AI 社区

我们可以通过加入 Applied AI 社区来学习和分享关于 n8n 和 AI 的知识。