OpenAI 的噩梦:DeepSeek R1 如何颠覆 AI 行业

一些简短的描述,OpenAI 在 AI 领域的主导地位正受到一个名为 DeepSeek 的新初创公司的挑战,该公司创建了一个名为 R1 的新开放权重模型,据称在大多数指标上超过了 OpenAI 的最佳模型。

DeepSeek R1 介绍

这是图片 1 的标题,OpenAI 的噩梦

DeepSeek R1 是一家由中国对冲基金运营的新 AI 初创公司,创建了一个名为 R1 的新开放权重模型,据称在大多数指标上超过了 OpenAI 的最佳模型。这在整个 AI 行业引起了震动,许多人想知道一个相对较小的初创公司是如何取得如此令人印象深刻的成绩的。

这是图片 1 的标题,OpenAI 的噩梦

DeepSeek R1 是一家由中国对冲基金运营的新 AI 初创公司,创建了一个名为 R1 的新开放权重模型,据称在大多数指标上超过了 OpenAI 的最佳模型。这在整个 AI 行业引起了震动,许多人想知道一个相对较小的初创公司是如何取得如此令人印象深刻的成绩的。

Pi 5 究竟能做什么?

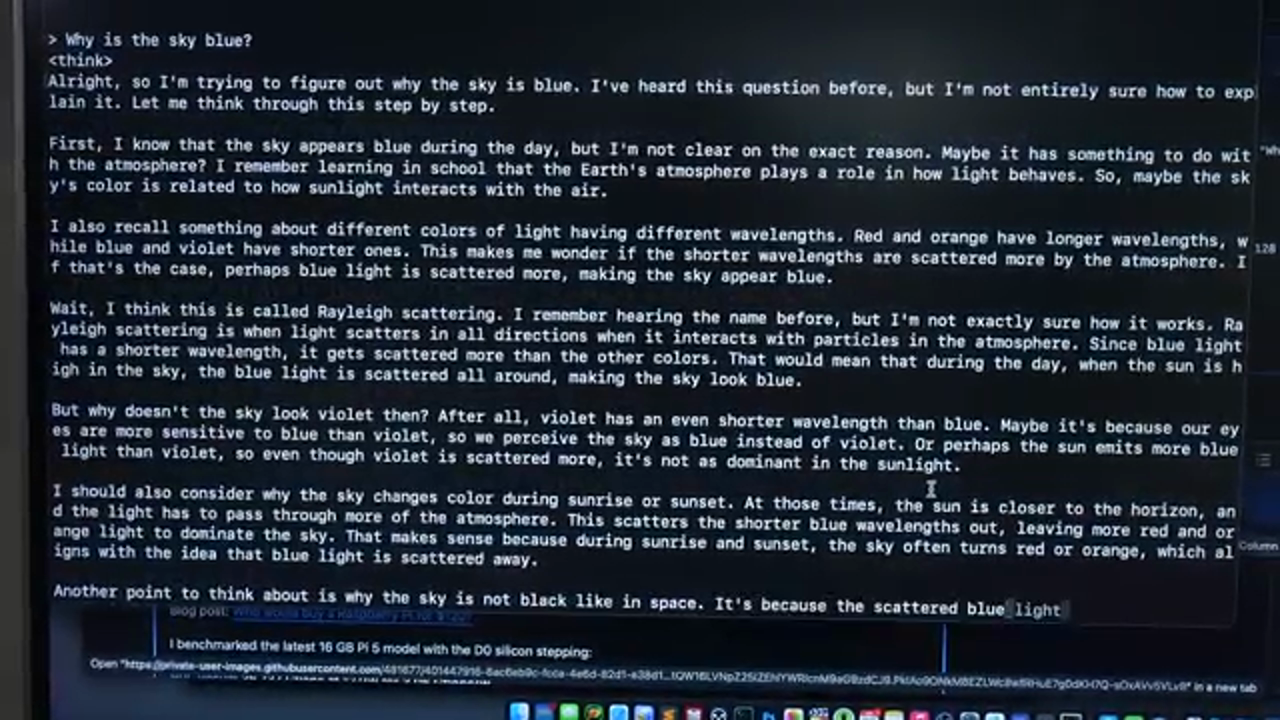

这是图片 2 的标题,Pi 5 功能

Pi 5 是一种小巧且相对便宜的计算机,可以运行 DeepSeek R1 模型,但有一些限制。这个模型可以蒸馏其他模型,使其在较慢的硬件上运行得更好,这意味着 Raspberry Pi 可以运行最好的本地 quen AI 模型之一。

这是图片 2 的标题,Pi 5 功能

Pi 5 是一种小巧且相对便宜的计算机,可以运行 DeepSeek R1 模型,但有一些限制。这个模型可以蒸馏其他模型,使其在较慢的硬件上运行得更好,这意味着 Raspberry Pi 可以运行最好的本地 quen AI 模型之一。

用 1% 的资源击败 OpenAI

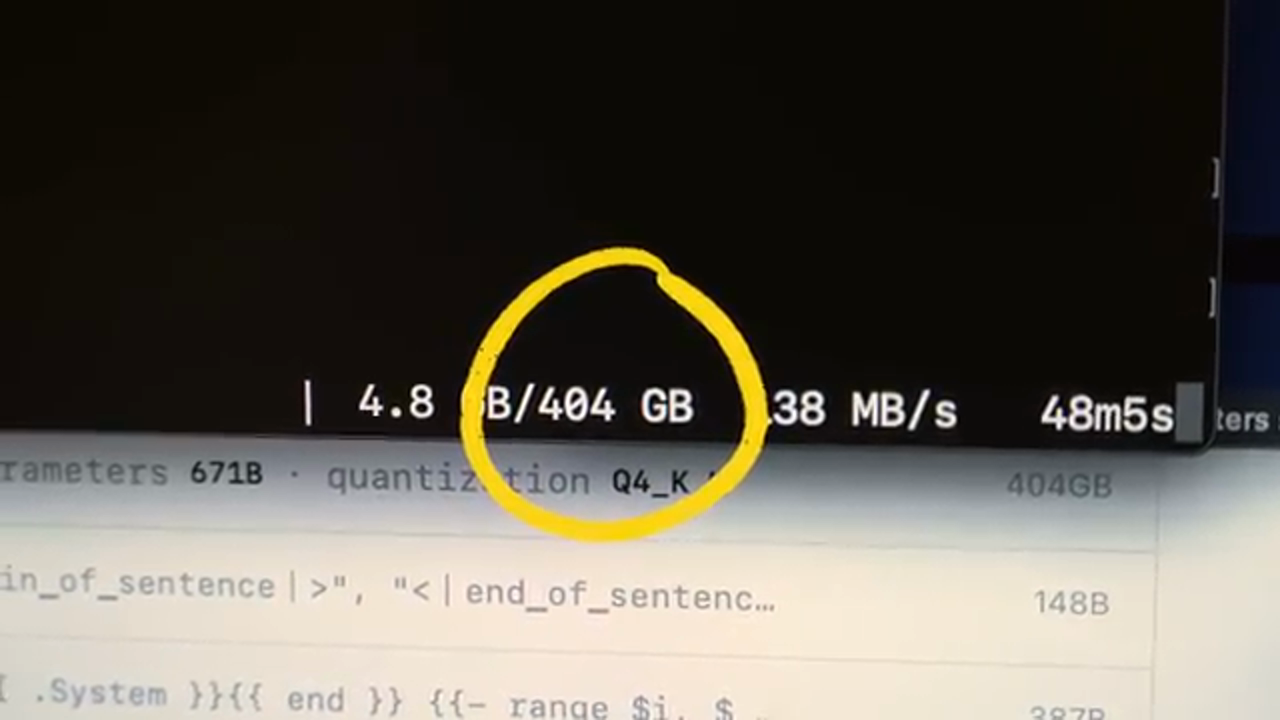

这是图片 3 的标题,DeepSeek R1 671b

DeepSeek 的模型在大多数指标上可以击败 OpenAI 的最佳模型,而且只用了 600 万美元,使用的是运行内存带宽只有 OpenAI 一半的 GPU。这是一个重大的成就,因为 OpenAI 的整个商业模式就是基于人们无法获得巨大的能源和 GPU 资源来训练和运行大型 AI 模型。

这是图片 3 的标题,DeepSeek R1 671b

DeepSeek 的模型在大多数指标上可以击败 OpenAI 的最佳模型,而且只用了 600 万美元,使用的是运行内存带宽只有 OpenAI 一半的 GPU。这是一个重大的成就,因为 OpenAI 的整个商业模式就是基于人们无法获得巨大的能源和 GPU 资源来训练和运行大型 AI 模型。

在 Raspberry Pi 上运行 DeepSeek R1

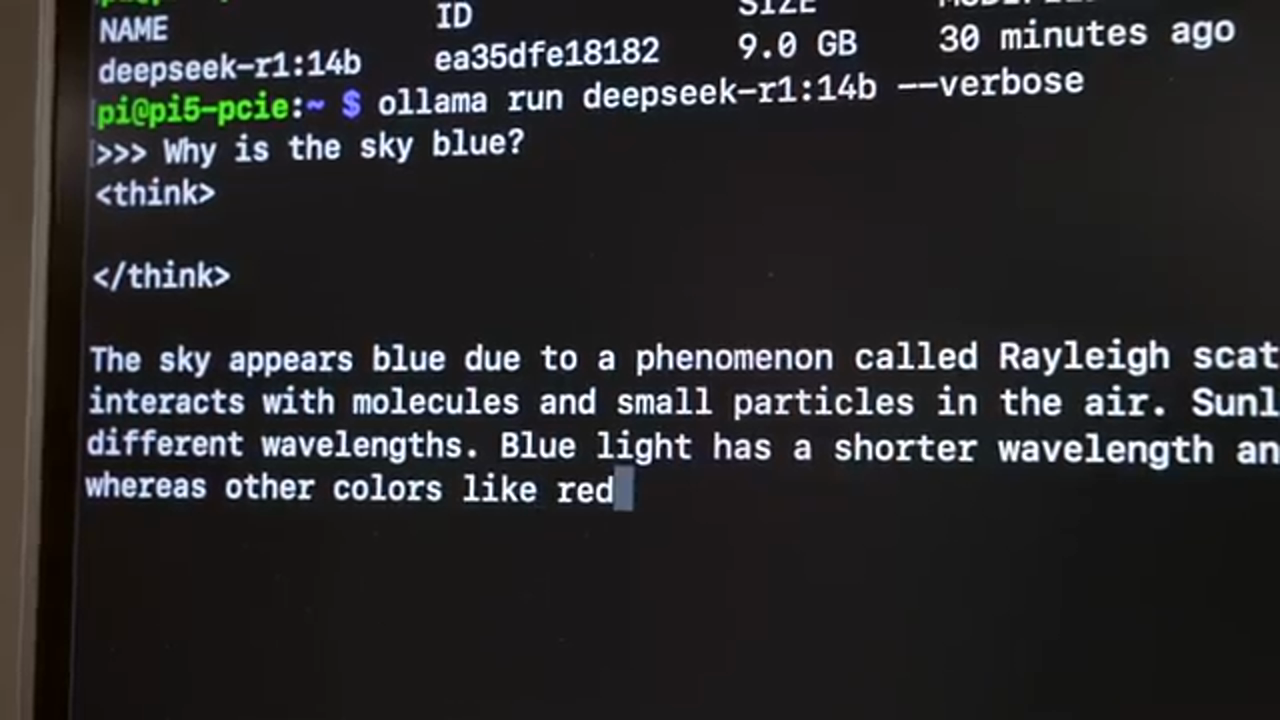

这是图片 4 的标题,Raspberry Pi

虽然 Raspberry Pi 技术上可以运行 DeepSeek R1,但不是同一个模型。DeepSeek R1 671b 是一个 400 GB 的模型,需要大量的 GPU 计算资源。不过,较小的 14b 模型可以在 Raspberry Pi 上运行,尽管速度较慢,大约每秒 1.2 个 token。

这是图片 4 的标题,Raspberry Pi

虽然 Raspberry Pi 技术上可以运行 DeepSeek R1,但不是同一个模型。DeepSeek R1 671b 是一个 400 GB 的模型,需要大量的 GPU 计算资源。不过,较小的 14b 模型可以在 Raspberry Pi 上运行,尽管速度较慢,大约每秒 1.2 个 token。

使用外部显卡加速 DeepSeek R1

这是图片 5 的标题,外部显卡

要加速 DeepSeek R1,可以使用外部显卡,这可以显著提高性能。使用 AMD W7700 显卡,模型可以以 20-50 个 token/秒的速度运行,具体取决于正在执行的工作类型。

这是图片 5 的标题,外部显卡

要加速 DeepSeek R1,可以使用外部显卡,这可以显著提高性能。使用 AMD W7700 显卡,模型可以以 20-50 个 token/秒的速度运行,具体取决于正在执行的工作类型。

在服务器上运行 DeepSeek R1

这是图片 6 的标题,服务器

DeepSeek R1 也可以在服务器上运行,这可以提供更令人印象深刻的性能。使用 192 核服务器,模型可以以大约 4 个 token/秒的速度运行,这比 Raspberry Pi 有显著的提升。

这是图片 6 的标题,服务器

DeepSeek R1 也可以在服务器上运行,这可以提供更令人印象深刻的性能。使用 192 核服务器,模型可以以大约 4 个 token/秒的速度运行,这比 Raspberry Pi 有显著的提升。

在 Raspberry Pi 和其他 Arm 板上运行 GPU

这是图片 7 的标题,在 Raspberry Pi 上运行 GPU

还有在 Raspberry Pi 和其他 Arm 板上运行 GPU 的选项,这可以显著提高性能。使用 AMD GPU 表现很好,英特尔开源驱动程序也适用,因此对于那些希望在基于 Arm 的设备上运行 AI 模型的人有很多选择。

这是图片 7 的标题,在 Raspberry Pi 上运行 GPU

还有在 Raspberry Pi 和其他 Arm 板上运行 GPU 的选项,这可以显著提高性能。使用 AMD GPU 表现很好,英特尔开源驱动程序也适用,因此对于那些希望在基于 Arm 的设备上运行 AI 模型的人有很多选择。

结论

AI 仍在巨大的泡沫中,Nvidia 在 DeepSeek 推出后一天内市值损失了超过 5000 亿美元。然而,这并不意味着 AI 不是一项重要的技术,DeepSeek R1 这样的 AI 模型有许多潜在的应用。随着技术的不断发展,将很有趣地看到它如何被使用及其潜在的应用。